OpenAIからの大発表!米OpenAIは2023年9月25日(現地時間)、人気のチャットAI「ChatGPT」に画像認識と音声会話の新機能を追加することを発表しました。

これによりChatGPTはマルチモーダルなコミュニケーション能力を獲得し、GPT-4Vとなりました。

「マルチモーダル」とは、複数の異なるタイプの入力や出力(例:音声、テキスト、画像)を組み合わせて情報を処理する手法のことを指します。

この「画像認識」機能によって、ユーザーは送信した画像に関する詳細な情報やアドバイスを直接取得することが可能になります。また、「音声会話」機能を活用することで、ユーザーはChatGPTと音声で直接コミュニケーションを取ることができるようになります。

なお、マルチモーダルな新機能「画像認識と音声会話」の導入は2週間以内を予定しており、ChatGPT PlusユーザーやEnterpriseユーザーが先行して利用を開始できる予定です。

「画像認識」機能は、PCやスマートフォンをはじめとするプラットフォームから利用可能です。また、「音声会話」機能はiOS(iPhone)及びAndroidに対応しています。

これまで文字だけでのコミュニケーションが主流だったChatGPTが、画像や音声といった多様な情報を取り扱えるようになることで、私たちのコミュニケーションの幅がどれほど広がるのでしょうか?

そこで、この記事では、「見る」「聞く」「話す」能力を持ったマルチモーダルなChatGPTの魅力と活用法を、初心者の方でも理解しやすい形で解説します。

この記事を読むことで、以下のメリットがあります。

- ChatGPTの新機能「画像認識・音声会話」の具体的な使い方とその背後の技術を学べる

- さまざまなシーンでの新機能の活用例を通じて、日常やビジネスでの新しい情報活用の方法を学べる

- 新機能をうまく取り入れることで、より効果的な情報の収集や意思決定のサポートを受けられるノウハウを手に入れる

ChatGPTの革新的な新機能の登場を前に、先駆けてその魅力を知るチャンスが到来しました。

この先進のコミュニケーション体験に関する情報を、いち早く手に入れ、未来への一歩を踏み出しませんか?

GPT-4V(GPT-4 with vision:画像認識機能付きGPT-4)とは?

OpenAIのChatGPTは、機能が絶えず進化しています。

そして、今回発表された最新のバージョンであるGPT-4Vにおいては、ChatGPTに視覚機能が追加され、従来のテキスト対話に「画像認識」機能が新たに組み込まれました。

さらに、音声会話の新機能も導入され、ChatGPTはマルチモーダルなコミュニケーション「テキスト、画像、そして音声を組み合わせた対話」が可能になりました。

「GPT-4V」については、OpenAI公式サイトに以下のように発表されています。

-1024x701.png)

「GPT-4V」に関するOpenAI公式サイトの要点

GPT-4V(GPT-4 with vision:画像認識付きGPT-4)は、ユーザーが提供した画像を解析する能力を持つ最新のAIモデルです。

このモデルは大規模言語モデル(LLM)であり、言語処理だけでなく画像処理も行えます。

これにより、マルチモーダルな機能を有しています。言語だけに対応する従来のシステムよりも多くの可能性を拓き、新しいインターフェースや機能を提供できます。

安全性に関しても、特に画像入力に対する評価や対策がしっかりと行われています。

このようなマルチモーダルなLLMの登場は、人工知能の研究と開発において重要な進展とされています。

ChatGPT「画像認識」機能:視覚で世界を理解する

まずは、新機能の中の「画像認識」機能から詳しくご紹介します。

このChatGPT「画像認識」機能の追加により、ChatGPTはマルチモーダルなコミュニケーションを実現し、文字情報だけでなく視覚情報も取り入れることで、ユーザーとのコミュニケーションの質を一層向上させることができるようになりました。

ChatGPT「画像認識」機能は、テキストベースのコミュニケーションをさらに進化させ、視覚情報を利用した新しい対話の機能です。

この新機能は、あなたの日常や仕事の中での疑問や課題を、画像を通して解決するための新しい道を開きます。

画像認識がもたらす新しい対話の形

ChatGPT「画像認識」機能は、文字情報だけでなく視覚情報を取り入れることで、ユーザーとのコミュニケーションの質を大きく進化させています。

ユーザーは直接関連する画像を送信することで、より具体的かつ適切な回答やアドバイスを受け取ることができます。

例えば、家の冷蔵庫の中身を撮影して送ることで、その食材を元にしたレシピの提案を受けたり、組み立てが難しい家具の部品を撮影してアドバイスを求めたり、グリルが起動しない原因を解決したりすることができます。

「画像認識」機能は、文字情報だけでは伝えきれない具体的な状況やニーズに対応するための強力なツールとして、ChatGPTの機能を大きく広げています。

「画像認識」機能の利用方法

ChatGPT「画像認識」機能は、まずはChatGPTの公式アプリ(モバイルアプリ)上で利用可能になります。

公式アプリでは、画像を撮影するか、既存の画像を選択することで、ChatGPTに送信することができます。

PCのブラウザからは、近々使えるようになるとのことです。

どのような画像が認識できるのか

ChatGPTは、日常の写真からスクリーンショット、テキストと画像が混在したドキュメントまで、さまざまなタイプの画像を認識できます。

それは、複数のデータ形式を理解し、処理できる人工知能であるマルチモーダルのGPT-3.5およびGPT-4の採用により、テキスト情報と同じくらいの精度で画像情報も解釈できるようになりました。

ChatGPT「画像認識」機能を活用した実例:自転車のサドル調節

OpenAIのデモによる「自転車のサドル調節方法」についての実際の活用例を紹介します。

OpenAIのデモ動画を見てみると、下の画像のようにユーザーは自転車のサドル部分の写真(画像)をChatGPTに送信し、「自転車のサドルの下げ方を教えて」と質問しています。

ChatGPTは、送信された画像を基に、自転車のサドルの下げ方を5ステップでアドバイスしました。

ここで注目すべきは、単純な質問への回答ではなく、提供された画像を基にした「自転車のサドルの下げ方」の具体的な回答をしている点です。

続いて、ユーザーは画像の一部を丸で囲み、「これはレバーですか?」と質問。

すると下の画像のように、ChatGPTは「これはレバーではありません。」と返答し、サドル調節部分がボルト式で、調節のためにはレンチが必要であることを説明しました。

その後、マニュアルとツールボックスの写真を2枚送信し、「このツールは正しいですか?」と質問。このやり取りから、一度に複数の画像を送信することも可能であることがわかります。

ChatGPTは、ツールを正確に認識し、「はい、そのツールは適切です。4mmのアレンキー(ヘックスや六角レンチとも呼ばれる)を使って、サドルのボルトを緩めて高さを調整してください。そして、安全第一で作業を行ってください。」とアドバイスを提供。

デモの終盤、ユーザーは調節後の自転車の写真と共に「完了しました!ありがとうございます」と送信。ChatGPTからは「どういたしまして!安全運転をお願いします。」という返信があり、デモが終了しました。

OpenAIのデモから明らかなように、ChatGPTは自転車のサドル部分がボルトで固定されていることを精確にキャッチし、調節には六角レンチが必要であることをアドバイスしています。

さらに、ChatGPTはサドルのみならず、他の部品についても的確に認識し、ユーザーの質問や悩みに応じて具体的な情報や助言を提供できます。

これにより、私たちの日常や仕事の中でのさまざまな疑問や課題を、画像とともにChatGPTに投げかけることで、的確な解答やアドバイスを即座に得ることが期待できます。

これは、マルチモーダルAIとしてのChatGPTの真価を象徴しており、新しいコミュニケーションの時代が到来しつつありますね!

「画像認識」機能の制限と限界

ChatGPT「画像認識」機能は非常に強力ですが、その制限や限界についても理解することが重要です。

特に、専門的なトピックや高リスクなシチュエーションでの使用には注意が必要です。

また、英語のテキストの処理は得意であっても、アルファベットを使用しない言語に関しては苦手であるとのことです。

ユーザーはこのような情報を理解し、適切に機能を使用する必要があります。

ChatGPT「音声会話」機能:新時代のモバイルでのコミュニケーション

上では、革命的な「画像認識」機能についてご紹介しましたが、ChatGPTの進化はそれだけにとどまりません。

次に、もう一つの注目すべき新機能、「音声会話」を詳しくご紹介します。

ChatGPT「音声会話」機能は、テキストだけでなく音声使用してAIとの会話を可能にする最新の機能です。

この機能は、ChatGPTのChatGPT公式アプリ(モバイルアプリ)にて提供されます。

これにより、移動中や手がふさがっているときでも、音声でのコミュニケーションが可能に。また、外出先での疑問の解消、家族向けの読み聞かせ要求、食卓での議論の解決など、多岐にわたる場面での利用が実現します。

「ChatGPT公式アプリ」についてはこちらの記事に詳しく解説しています。

「音声会話」機能の利用方法

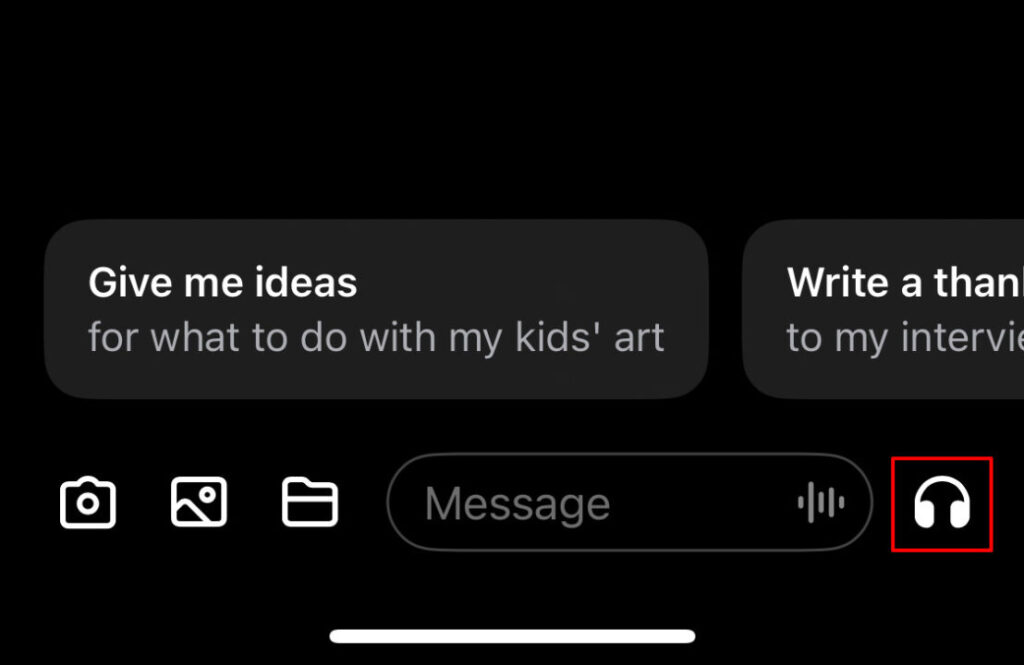

「音声会話」機能は、次のように利用します。

「音声会話」機能の利用方法

- ChatGPTの公式アプリ(モバイルアプリ)を開きます。

- [Settings]から[New Features]を選択して、「音声会話」機能を有効にします。

- ホーム画面の右上隅にあるヘッドフォンのアイコンをタップすることで、音声入力が可能になります。

- 5つの異なる音声から選択して、あなたの好みの音声でChatGPTと対話することができます。

「音声会話」機能の背後にある技術

この革新的なChatGPT「音声会話」機能は、新たに開発されたtext-to-speechモデルによって駆動されています。

text-to-speechモデルは、テキストと数秒のサンプル音声だけで、人間のような音声を生成することが可能です。特に、OpenAIはプロの声優との協力のもと、5種類のユニークな音声を制作しました。

また、ユーザーがChatGPTに音声で話しかける際の音声認識には、「Whisper」というOpenAIの音声認識システムが使用されています。

なお、この音声合成技術は、米Spotifyでも音声翻訳機能としての試験運用が行われているとのこと。Spotifyでは、ポッドキャストのエピソードを英語から他の言語へと翻訳し、元の声のまま再生するサービスが始まる予定です。

ChatGPT「音声会話」機能の実際の利用シーン

OpenAIは、ChatGPT「音声会話」機能をデモンストレーションするために、様々な実例を公式サイトに提供しています。

これらのサンプルは、新しい「音声会話」機能の多様性と可能性を示すものとなっています。

物語

OpenAIのデモでは、母親が子供のための読み物をChatGPTに要求する場面が示されています。

実際のサンプルとして、森の中での猫の家族のエピソードが紹介されています。穏やかな森、母猫リラ、子猫ミロとの日常のやりとりを通じて、ユーザーは子供たちへの読み聞かせや、落ち着いた夜の物語としてこの機能を利用することができます。

レシピ

ChatGPTは料理のレシピの紹介も可能です。例として、「アイスラテの作り方」が示されています。

ユーザーは料理のレシピや、新しいドリンクのアイディアなど、日常の料理の参考として音声会話機能を活用することができます。

スピーチ

ある特別な日やイベントのスピーチ文の生成も可能です。

例えば、結婚式での新郎や新婦へのメッセージなど、感動的なメッセージをChatGPTに依頼することができます。このサンプルでは、姉の結婚を祝福する心温まるメッセージが紹介されています。

詩

感情や日常の出来事を詩の形にすることも可能です。

鍵をなくした経験をベースにしたユーモラスな詩のサンプルが提供されており、ユーザーは日常の小さな出来事や、特別な日の記念として詩を生成することができます。

説明

ChatGPTは、日常的なフレーズや文化的な背景を説明することも得意としています。

例として、アメリカの映画や歌に関する背景情報の説明があります。このような機能を使えば、学習や研究の際に、特定のトピックやフレーズの背景知識を手軽に得ることができます。

以上のように、ChatGPT「音声会話」機能は、日常の様々なシーンでの活用が期待されます。

物語の生成からレシピ、スピーチ、詩、説明まで、多岐にわたるコンテンツを提供することが可能となっています。

英語学習にも活かせる「音声会話」機能

ChatGPT「音声会話」機能を使えば、以下のような英語学習ができます。

ChatGPT「音声会話」機能でできる英語学習

- 生成された英文を音声で読み上げさせ、その内容を理解する学習

- 自らの英語発話をテキストに変換し、そのテキストの品質を確認することで、自分の発声のレベルを測る学習

- ユーザーが英語で音声入力し、ChatGPTが読み上げる形での英会話学習

このように、「音声会話」機能で効果的に英語学習をすることが可能です。

「ChatGPTで英語学習」についてはこちらの記事に詳しく解説しています。

ChatGPT 新機能「画像認識・音声会話」の活用例

現代の技術革命の中で、ChatGPTの画像認識および音声会話の新機能は、ユーザーの日常生活や仕事に多大な便益をもたらすものとして注目されています。

マルチモーダルな能力を備えたこの新機能がどのような状況で役立つのか、具体的な活用例を以下に詳述します。

「旅行」や「日常生活」での使用例

旅行

旅行者が未知の都市や観光地を訪れた際、周りの風景や建物、文化的な象徴物についての知識が欠けていることはよくあります。

このような場面で、ChatGPT「画像認識」機能を使用すれば、撮影した写真から該当する場所や物の詳細な情報を得ることができます。

さらに、「音声会話」機能を使用して地元の言葉での道案内やお店の情報も取得可能です。

日常生活

家庭での調理中にレシピの手順が分からない場合や、新しい家電製品の使い方が難しい場合など、ChatGPTに画像や音声で問い合わせることで、手順の説明やアドバイスを受け取ることができます。

特に、「音声会話」機能を利用すれば、手を使わずに操作方法などの情報を得ることができます。

「教育」や「仕事」での応用例

教育

生徒や学生が学習内容に関する疑問点や難解な課題に直面した際、ChatGPT「画像認識」機能を活用して教科書やノートの写真を送信すれば、詳しい解説や関連する情報を提供してもらえます。

「音声会話」機能を利用することで、生徒が自らの言葉で疑問を直接問い合わせることも可能です。

仕事

職場での新しいプロジェクトやプレゼンテーションの準備中に、参考となる資料や画像を基にChatGPTに詳細な情報やアイディアを求めることができます。

特に複雑なグラフやデータの解析が必要な場合、「画像認識」機能を使ってデータの詳細な解釈や意見を取得することが考えられます。

「音声会話」機能により、ミーティング中などのリアルタイムでの問い合わせもスムーズに行うことができます。

これらのChatGPTの画像認識および音声会話の新機能により、ChatGPTは私たちの日常生活や仕事においてより実用的で効率的なツールとしての位置付けが強まってきています。

ユーザーはこれらの機能を最大限に活用することで、多くの情報や知識を手に入れることができるでしょう。

ChatGPT 新機能「画像認識」と「音声会話」の注意点と懸念

ChatGPTの進化する新機能は、マルチモーダルAIの進化を代表するものとして注目されていますが、それらの機能にも特有の注意点や懸念が存在します。

これらの点を正確に理解し、適切な方法での利用が必要です。

「画像・音声」の誤解と誤解釈

「画像認識」機能

ChatGPTは大半のケースで的確な情報を提供しますが、特定の画像の内容や背景情報を完全に正確に解析することは難しい場面もあります。

特に専門的な画像や、詳細が微細である画像に関しては、他の情報源や専門家の意見を参照することを強く推奨します。

「音声会話」機能

言葉のニュアンスやアクセント、背景ノイズなどの影響で、ChatGPTが完全に正確な情報を提供しない場合も考えられます。

特に専門的な質問や緊急を要する場面では、他の情報源や専門家との確認が必要となるでしょう。

個人情報の取り扱い

「画像認識」機能

写真を共有する際、偶発的に個人情報(顔、住所、証明書等)が含まれている可能性があります。

このような情報の漏洩を防ぐため、写真を送信する前に必ず内容を確認しましょう。

「音声会話」機能

声には個人を特定できる情報が含まれている場合があります。また、背景に会話が聞こえる場合、それも録音・送信される可能性がありますので、注意が必要です。

モデルの限界

ChatGPTの新機能は、英語の情報処理には高い能力を持っていますが、他の言語や特定の専門分野ではその性能が制限されることがあります。

特に、非英語のコンテンツや高度な専門的内容に関しては、ChatGPTの回答だけを頼りにせず、他の情報源や専門家の意見も参照することをおすすめします。

結論として、ChatGPTの新機能は多岐にわたる用途で利用することができますが、その限界やリスクを十分に理解した上で適切に使用することが求められます。

安全かつ有効な利用を心がけましょう。

【10/14追記】「画像認識」機能を、「文字起こし」と「グラフからデータ抽出」で使ってみた!

ようやく「画像認識」機能が、PCのブラウザで使えるようになりました。

ファイルのアイコンが、入力欄の左端に表示されるようになりました。ファイルのアイコンをクリックすると、画像を添付して送信することできます。

それでは、早速いくつか検証してみたいと思います。

「画像認識」機能で、「文字起こし」をしてみた結果は?

それでは、当記事の一部をキャプチャした下の画像から、文字起こしをしてみます。

まずは、ファイルのアイコンをクリックして画像を添付します。

次に、以下のプロンプト(命令文)を出してみました。

ChatGPTの回答は以下のとおり。

ChatGPT 新機能「画像認識・音声認識」使い方:「見る・聞く・話す」機能が追加!

📅 2023年10月11日

ChatGPT Plus 新機能登場!

画像認識 → 音声認識

見る・聞く・話す

今すぐ使ってみよう!

OpenAIからの大発表!OpenAIは2023年9月25日(現地時間)、人気のチャットAI「ChatGPT」に「画像認識」と「音声認識」の新機能を追加することを発表しました。

これによりChatGPTはマルチモーダルなコミュニケーション能力を獲得し、GPT-4V ともいえました。

「マルチモーダル」とは、複数の形態をもつタイプの入力や出力(例:音声、テキスト、画像)を組み合わせて情報を処理する手法のことを指します。

この「画像認識」機能によって、ユーザーは端末上で画像に関する詳細な情報やアドバイスを直接取得することが可能になります。また、「音声認識」機能を活用することで、ユーザーはChatGPTと声で直接コミュニケーションを取ることができるようになります。

OpenAI

Research – API – ChatGPT – Safety – Company

ChatGPT can now see, hear, and speak

We are beginning to roll out new voice and image capabilities in ChatGPT. They offer a new, more intuitive type of interface by allowing you to have a voice conversation or show ChatGPT what you’re talking about.

一部、日本語に誤りがある部分もありましたが、記事はもちろん、記事の中の画像文字まで、高い精度で文字起こしをしてくれました。

「画像認識」機能で、「グラフからデータ抽出」をしてみた結果は?

次は、グラフからデータ抽出をしてみます。

参考にするグラフは、野村総合研究所が作成した「Openai.comへの日本からのアクセス数推移」のグラフです。

.png)

画像を添付して、以下のプロンプト(命令文)を出してみました。

ChatGPTの回答は以下のとおり。

画像に表示されているグラフから、以下の情報を抽出できます:

- グラフの上部に表示されている情報: 対象サイトは “Openai.com”、期間は “2022年12月1日” から “2023年5月31日” まで。

- グラフのタイトル: アクセス数

- x軸の期間: 2022年12月1日 から 2023年5月

- y軸の範囲: 0 から 900

- ピークの日付とアクセス数: 2023年5月12日, 767アクセス

アクセス数の傾向は、2022年12月初めから徐々に増加し、2023年5月にピークを迎えた後、変動しながらも減少傾向にあることがわかります。

具体的な数値データや細かい変動は画像から直接抽出することは難しいため、グラフの大まかな傾向や主なポイントの情報のみを提供しています。

細かい数値が読み取れないグラフであるにも関わらず、抽出できる数値を正確に出して、さらに傾向も教えてくれました。

次に、細かい数値がわかる下のグラフで試してみます。

画像を添付して、以下のプロンプト(命令文)を出してみました。

ChatGPTの回答は以下のとおり。

画像のグラフから以下の情報を抽出しました:

タイトル:

- 調査4: ChatGPTの性年代別利用率の変化 (回答者数15〜69歳、2023年6月3〜4日)

データ(2023年4月の利用率と2023年6月の利用率):

- 全体 年齢:

- 4月: 15.4%

- 6月: 12.1%

- 男性 全体:

- 4月: 21.6%

- 6月: 17.7%

- 女性 全体:

- 4月: 9.0%

- 6月: 6.2%

- 男性 10代:

- 4月: 20.0%

- 6月: 21.4%

(中略)

このデータから、特定の年齢層や男女におけるChatGPTの利用率の変化を観察することができます。

グラフに表示されている全ての数値を教えてくれました。

ChatGPTの回答の最後の言葉からわかるように、ChatGPTはこのグラフが何を示すのかまで正確に認識しています。

この検証から、ChatGPTはグラフのデータ抽出においても、非常に高い精度の「画像認識」能力を持っていることが明らかになりました。

【10/24追記】「画像認識」機能で分析し、テキストから画像生成。その結果に驚く!

ChatGPTの注目の新機能「画像認識」と「画像生成AI」を組み合わせ、その可能性を探ってみました。

この目的は、ChatGPTの「画像認識」機能が、どれほど高度な表現力や解析能力を持ち、そしてそのテキストが画像生成AIによってどれほど忠実に再現されるのかを検証することです。

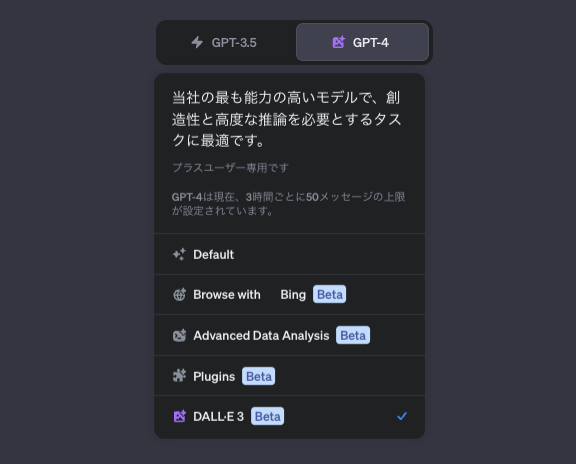

さらに今回の検証では、2023年9月21日(現地時間)に、米OpenAIが発表したChatGPTの新機能「DALL-E 3」を使います。

この「DALL-E 3」は、ユーザーが入力したテキストに基づいて高解像度の画像を生成する能力を持つ画像生成AIで、ついにChatGPTで画像生成が可能となったのです。

ChatGPTの新機能「DALL-E 3」についてはこちらの記事に詳しく解説しています。

さて、今回の検証結果が非常に驚きのものであったため、ぜひ最後まで目を通していただきたいと思います。

「画像認識」機能を使い、画像の内容をテキストで出力

それでは、まず「画像認識」機能を使い、特定の画像の内容を詳細に解析し、その結果をテキストで出力します。

ここで注目すべきは、ChatGPTの「画像認識」機能が画像をどれだけ詳しく、そして正確に言語化できるかという点です。

今回分析対象として選んだのは、下記の画像。これはOpenAI公式サイトで紹介されている「DALL-E 3」による生成画像です。

果たして、この画像をどれだけ忠実に再現できるのでしょうか。

この画像を添付して、以下のプロンプト(命令文)を出してみました。

結果、上の図のとおり、非常に詳細な内容が「画像認識」機能により言語化されました。

「画像認識」機能で解析されたテキストを元に、「DALL-E 3」を使用して画像を生成

続いて、この解析されたテキストを元に、ChatGPTの新機能「DALL-E 3」を使用して新たな画像を生成します。

具体的な手順は以下の通りです。

ChatGPTで「DALL-E 3」を選択します。

そして、以下のプロンプト(命令文)を入力しました。

ChatGPTの「DALL-E 3」で生成された画像がこちらです。

結果、言葉で表すのが難しいほどの驚きの画像が生成されました。

画像のサイズに関する指定はありませんでしたので、横長のデザインとなっています。しかし、それぞれの画像の再現性や出来映えは素晴らしいのではないでしょうか?

元の画像には独特のイラスト風の雰囲気が感じられますが、最後の画像はそのタッチが元の画像に非常に近いと感じました。

今回の検証結果には、正直、驚かされました。

【11/22追記】ChatGPTアプリ、「音声会話」機能が無料ユーザーにも開放!

米OpenAIは2023年11月21日(現地時間)、今年5月にリリースしたChatGPTのモバイルアプリの「音声会話」機能を無料ユーザーにも利用可能にしたと、X(旧Twitter)で発表しました。

ChatGPTの「音声会話」機能を使用するには、アプリを立ち上げた画面の右下にあるヘッドフォンのアイコンをタップするだけです。

「音声会話」機能は日本語を含む複数の言語に対応しており、多言語での会話が可能となっています。

サム・アルトマンCEO解任などOpenAI騒動のユーモアを交えた音声デモ

OpenAIが公開した音声デモには、「すごい長い夜で、チームのみんなは腹ペコだ。778人分のピザを注文するとしたら、16インチのピザを何枚注文すればいい?」という質問が含まれています。

この778人という数字は、OpenAIの総従業員数に基づいたもの。

つまり、これは、同社の状況を皮肉ったようなユーモアの表現と言えます。

というのも、OpenAI内では11月17日の取締役会におけるサム・アルトマンCEOの事実上の解任に関連し、内部的な混乱が続いています。

報道によれば、従業員の約90%がアルトマン氏の復帰と取締役の辞任を求める書簡に署名しているとのこと。これは、OpenAIの大きな変動を示しており、OpenAIの今後に大きな影響を与える可能性があります。

「サム・アルトマンCEO 退任の衝撃!OpenAI 解任の波紋と未来予測」についてはこちらの記事に詳しく解説しています。

の衝撃!OpenAI-解任の波紋と未来予測-300x158.jpg)

まとめ

OpenAIの人気チャットAI、ChatGPTが一段とパワーアップしました。特に、最新バージョンであるGPT-4Vの導入により、マルチモーダルなコミュニケーションの時代が到来しています。

GPT-4Vによって搭載された新たな「画像認識」機能は、文字だけでなく視覚情報も組み合わせることで、新しい対話の形を提供します。この機能により、ユーザーが抱える疑問や課題をより総合的な情報を用いて解決することが可能になりました。

また、「音声会話」機能は、モバイル上での対話をより自然にし、コミュニケーションの幅を広げています。

ただし、新機能の使用には注意が必要で、特に画像や音声の誤解及び誤解釈を防ぐための知識が求められます。

最後に、ChatGPTの新機能「画像認識」と「音声会話」の重要なポイントをまとめます。

ChatGPT 新機能「画像認識」と「音声会話」の重要なポイント

- 「画像認識」機能:PCやスマートフォンから、ユーザーが送信した画像の内容を解析。具体的な物や状況に基づいた情報提供やアドバイスが得られるようになります。

- 「音声会話」機能:モバイルデバイスで、音声を使用してChatGPTとリアルタイムで対話することが可能。移動中や手がふさがっているときでも、音声でのコミュニケーションができます。。さらに自然なコミュニケーションが実現されます。

- 多様な場面での対応:日常のささいな疑問から、業務上の複雑な問題まで、幅広いシチュエーションで適切な情報やアドバイスを提供します。

- デバイスの違い:音声会話は主にモバイル向け、画像認識はPCを含む各プラットフォームで利用可能です。

- 個人情報の取扱注意:声や背景音、写真中の情報など、個人を特定する情報の取り扱いには十分な注意が必要です。

- モデルの限界:英語中心の性能のため、非英語や専門的内容に関しては他の情報源の参照を推奨します。

- 導入予定:「画像認識」機能と「音声会話」機能の導入は2週間以内(2023年9月25時点)を予定。ChatGPT PlusユーザーやEnterpriseユーザーが先行して利用を開始します。

これらのマルチモーダルな新機能を活用することで、コミュニケーションの質と効率が飛躍的に向上します。

この新しい時代の波に乗り遅れないよう、積極的に新機能を体験し、その可能性を最大限に引き出してみてください。

これまでに紹介したChatGPT 新機能の一覧

ChatGPTは日々進化しており、新機能が頻繁に追加されています。

これらの新機能は、ユーザーの使いやすさを向上させるため、またより多様な用途でChatGPTを活用できるように設計されています。

これまでに紹介した新機能は、定期的に更新される「ChatGPT 新機能の一覧(カテゴリページ)」にて詳しく解説しています。

新機能を効果的に活用することで、ChatGPTの可能性をさらに広げることができます。

新機能のアップデート情報は、当ブログで随時お知らせしていますので、最新の情報をチェックして、ChatGPTの魅力を最大限に活用しましょう!

最後までお読みいただきありがとうございました!

コメント